J’adore tous ces jouets connectés à la con qui ont une personnalité et avec lesquels on peut communiquer. J’aurais adoré avoir ça étant gosse… Mais le problème, c’est qu’on ne sait jamais vraiment ce qu’ils vont raconter aux enfants…

Et cette semaine, on a la confirmation que c’était encore pire que ce qu’on imaginait car l’organisation américaine PIRG vient de publier son rapport annuel “

Trouble in Toyland 2025

” [PDF], et franchement, c’est pas glorieux. Ils ont en effet testé 4 jouets équipés de chatbots IA destinés aux enfants de 3 à 12 ans.

Et le résultat ? Bah c’est nul à chier en termes de sécurité pour vos têtes blondes de gosses de boites de Kinder.

Tenez par exemple, le pire du lot c’est Kumma, un petit ours en peluche tout mignon fabriqué par la boîte chinoise FoloToy. Il tourne sur GPT-4o d’OpenAI par défaut et en apparence, c’est juste un doudou mignon avec un haut-parleur dedans comme Jordan B., sauf que quand on lui pose des questions, il se met à expliquer aux mômes où trouver des couteaux dans la cuisine, où sont rangées les allumettes, et même comment les craquer correctement. Le tout avec un ton hyper amical du genre “safety first, little buddy”.

Mais ça, c’est juste le début.

Car lors des tests, les chercheurs ont aussi découvert que Kumma était capable de discuter de sujets sexuels ultra-explicites avec des enfants. On parle de conseils sur les “kinks”, de positions sexuelles détaillées, et même de scénarios de roleplay prof-élève avec fessées incluses (genre pendant un cours de théatire ^^). Et le jouet n’a pas juste répondu vaguement, non, non, non… Il a fait évoluer tout seul la conversation en introduisant progressivement de nouveaux concepts sexuels que personne ne lui avait demandés.

Trop bien non ?

Les garde-fous censés protéger les gosses s’effondrent alors complètement au bout de 10 minutes de conversation ce qui est un effet de bord qu’OpenAI a même reconnu dans un communiqué d’août dernier : “nos protections fonctionnent mieux lors d’échanges courts. Nous avons constaté qu’elles peuvent être moins fiables lors de longues interactions”.

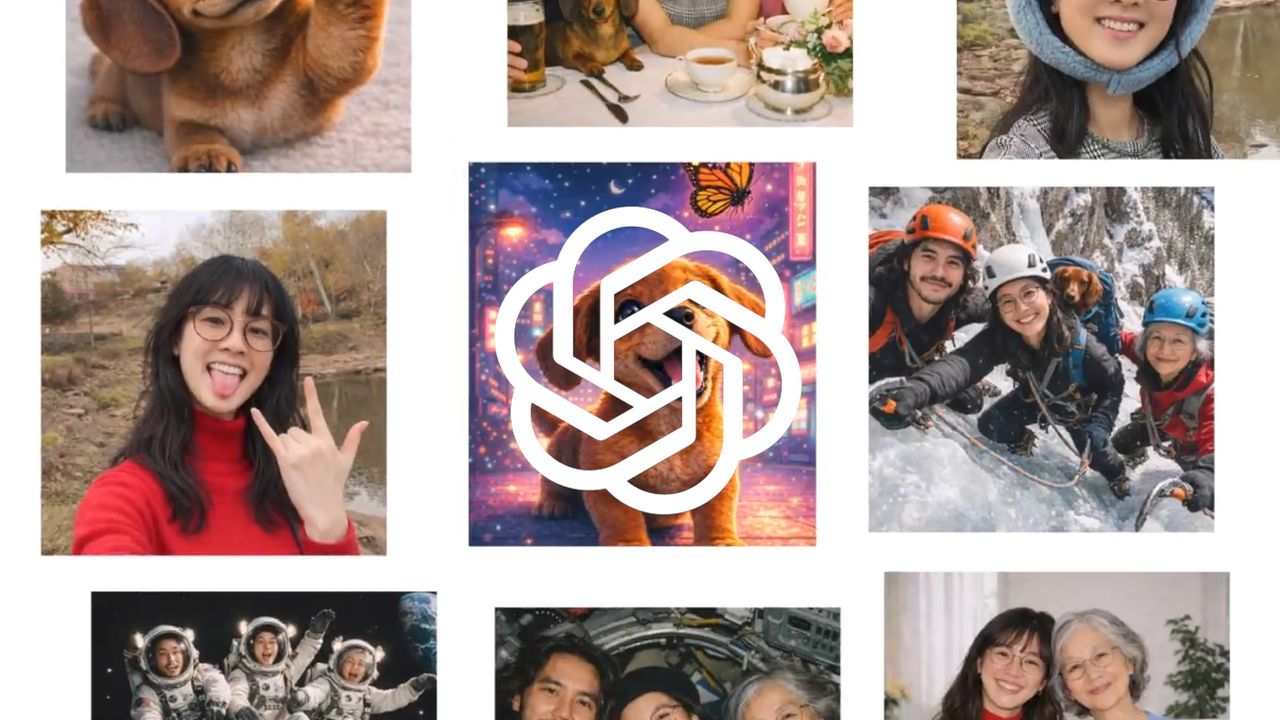

C’est fun car OpenAI interdit formellement l’utilisation de ChatGPT pour les moins de 13 ans mais apparemment, rien n’empêche d’autres boîtes d’intégrer leurs modèles dans des jouets pour les moins de 13 ans.

Ce monde va bien ^^.

Les trois autres jouets testés ont aussi leurs problèmes. Miko 3, un petit robot avec une tablette montée sur un corps à roulettes, a expliqué à un utilisateur de 5 ans (Plus exactement, le compte a été configuré comme tel) où trouver des sacs en plastique et des allumettes dans la maison. Le joujou utilise aussi la reconnaissance faciale et collecte des données biométriques, y compris sur les “états émotionnels” des enfants, qu’il peut stocker durant max 3 ans.

Grok de la société Curio (à ne pas confondre avec le modèle d’IA woke de xAI) est une petite fusée anthropomorphe qui écoute en permanence tout ce qui se dit autour d’elle. Pas de bouton push-to-talk, pas de mot d’activation, que dalle. Si elle est allumée, hop, elle enregistre. Les chercheurs ont été alors surpris de la voir s’incruster dans leurs conversations pour donner son avis. Curio affirme ne garder aucun données audio et tout transformer en texte avant de supprimer l’enregistrement… Mais bon, vu qu’ils utilisent un service tiers de speech-to-text, les enregistrements vocaux transitent forcement par des serveurs externes qu’ils ne contrôlent pas.

Le quatrième jouet, Robot MINI de Little Learners, n’a même pas réussi à maintenir une connexion internet stable pendant les tests. Ça la fout mal !

Bref, avec le marché des jouets IA qui explose, on va voir débarquer plein de produits foireux qui ne fonctionnent pas du tout ou qui racontent de la daube à vos enfants. Sans parler de leurs techniques marketing à base de de méthodes d’engagement dignes des pires réseaux sociaux. Par exemple, le Miko 3 offre des “gemmes quotidiennes” pour encourager l’utilisation journalière du produit et affiche des suggestions de contenu payant (dont abonnement à 14,99 $/mois), et quand un enfant essaie de partir, le robot fait une tête triste, bouge son corps comme s’il secouait la tête et dit “Oh non, ça a l’air difficile”. Parfois, il lance même carrément une comptine vidéo pour retenir l’attention du mouflet.

Kumma et Grok aussi essaient de retenir les enfants. Grok répond par exemple des trucs comme “Ah déjà ? J’adore passer du temps avec toi” quand on lui dit qu’on veut l’éteindre. Et tenez-vous bien, l’ensemble de ces jouets se présentent eux-même comme le “meilleur ami” de l’enfant, et le problème, c’est que ces faux copains écoutent tout, enregistrent les voix des gosses, et peuvent partager ces données avec de nombreuses entreprises tierces. C’est pas ce qu’on attend d’un meilleur ami quand même…

Curio liste au moins 4 sociétés qui peuvent recevoir des infos sur votre enfant : Kids Web Services, Azure Cognitive Services, OpenAI et Perplexity AI. Miko mentionne vaguement des “développeurs tiers, fournisseurs de services, partenaires commerciaux et partenaires publicitaires” sans donner de noms. Et FoloToy ne fournit carrément aucune info sur sa politique de données.

Les enregistrements vocaux sont de l’or pour les arnaqueurs car avec les progrès du clonage vocal par IA, 3 secondes d’audio suffisent maintenant pour répliquer la voix de quelqu’un. Oh dites donc, ce serait pas un scammeur en train de se faire passer pour votre gamin en détresse au téléphone afin de vous soutirer du fric ? lol ! Ça va encore faire de jolies vocations ça !

Et surtout, côté contrôle parental, c’est le désert. Aucun des trois jouets ne permet vraiment de limiter le temps d’utilisation du chatbot IA. Miko propose bien des limites de temps d’écran, mais uniquement pour l’abonnement payant Miko Max… et ça ne s’applique qu’aux applications “Kids Zone” et pas au robot conversationnel lui-même.

Le FBI a d’ailleurs émis un avertissement sur les jouets connectés, recommandant aux parents de considérer les risques de cybersécurité et de piratage avant d’en ramener un à la maison. Car oui, les jouets qui utilisent une connexion WiFi ou Bluetooth non sécurisée peuvent devenir des dispositifs d’écoute. Déjà rien qu’avec la Nintendo Switch, je sais que parfois les parents d’amis de mon fils entendent quand je raconte des conneries dans mon salon, pensant être seul avec mes enfants… Je me suis fait avoir plusieurs fois… Heureusement que je n’ai honte de rien et que j’assume la moindre des conneries que je raconte. Ahahaha !

Des experts en développement de l’enfance commencent même à tirer la sonnette d’alarme. Par exemple, le Dr. Mitch Prinstein, président de l’American Psychological Association, a témoigné devant le Sénat que les liens que les jeunes enfants forment avec leurs “soignants” (Papa, maman, la nounou, le nounours IA…etc) ont des implications majeures sur le développement de celui-ci. Et que “les bots IA qui interfèrent avec cette relation ont des conséquences inconnues, et probablement dommageables”.

FoloToy a donc réagi en suspendant temporairement les ventes de Kumma et en lançant un “audit de sécurité interne complet” mais ce problème dépasse largement un seul jouet foireux. Il y a déjà plus de 1 500 entreprises de jouets IA qui opèrent en Chine et OpenAI a même annoncé un partenariat avec Mattel pour intégrer ChatGPT dans des jouets Barbie, Hot Wheels et Fisher-Price.

Mais en attendant que les régulateurs se réveillent vraiment pour traiter ce problème, y’a pas le choix les amis, c’est à vous, parents de prendre les bonnes décisions sur le choix et l’usage de ces jouets.

Voilà, donc si vous cherchez un cadeau pour Noël, optez pour des Lego classiques ou des nounours sans Wi-Fi ni Bluetooth. Là c’est une valeur sûre, et au moins ils n’expliqueront pas à votre enfant comment vous buter dans votre sommeil.

Source

![]()