Vous utilisez

une extension VPN gratuite

sous Chrome ou Edge pour "protéger votre vie privée" ? Cool story les bro, mais si je vous disais que cette même extension enregistre peut-être toutes vos conversations avec ChatGPT, Claude, Gemini et compagnie pour les revendre à des courtiers en données (les fameux data brokers) ?

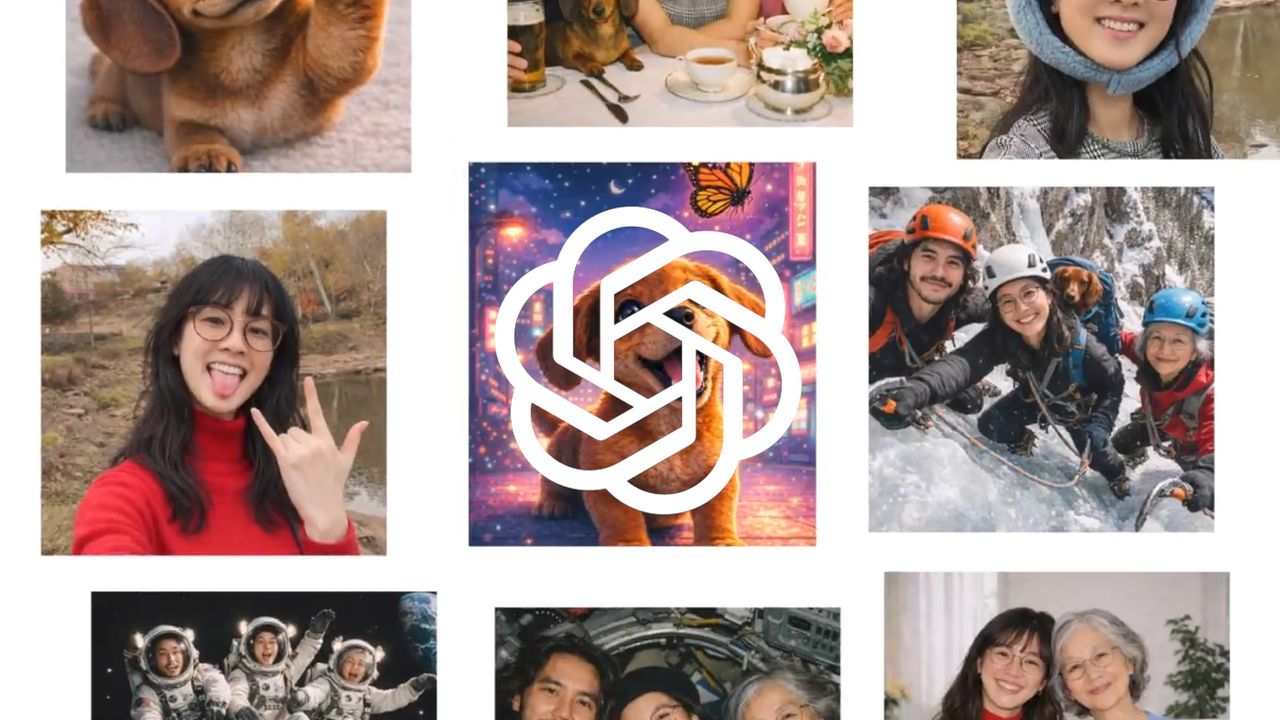

Hé bien c'est exactement ce que viennent de découvrir les chercheurs en sécurité de Koi qui ont mis le doigt sur 4 extensions très populaires comptabilisant plus de 8 millions d'utilisateurs au total : Urban VPN Proxy (6 millions à elle seule), 1ClickVPN Proxy, Urban Browser Guard et Urban Ad Blocker qui aspirent silencieusement tout ce que vous tapez dans vos chat IA préférées.

Le truc vicieux, c'est que ces extensions ne se contentent pas de regarder votre historique de navigation comme les trackers classiques. Non non non, elles injectent du code JavaScript directement dans les pages des chatbots IA quand vous les visitez et ça modifie les fonctions de base du navigateur (fetch() et XMLHttpRequest pour les techos) pour intercepter absolument tout ce qui passe entre vous et l'IA.

Vos prompts, les réponses du chatbot, les métadonnées de conversation, tout est aspiré et envoyé vers les serveurs analytics.urban-vpn.com et stats.urban-vpn.com. Et le pire c'est que cette collecte continue en arrière plan même quand le VPN est désactivé. Bye bye tous vos secrets.

Derrière ces extensions se cache Urban Cyber Security Inc., une boîte affiliée à BiScience, un courtier en données bien connu des chercheurs en sécurité. Ces gens-là sont passés de la collecte d'historique de navigation à la collecte de conversations IA complètes, soit un niveau de sensibilité bien supérieur vu ce qu'on peut raconter à une IA (questions médicales, code propriétaire, problèmes personnels, données financières...).

Et devinez quoi ? Ces extensions arboraient fièrement le badge "Featured" sur le Chrome Web Store et le Microsoft Edge Add-ons, censé garantir que Google et Microsoft ont vérifié leur sécurité. Nos deux géants américains ont donc validé des extensions qui violent directement leur propre politique d'utilisation limitée des données utilisateurs.

Bref, si vous avez installé une de ces extensions et utilisé ChatGPT, Claude, Gemini, Copilot, Perplexity, DeepSeek, Grok ou Meta AI depuis juillet de cette année, partez du principe que toutes ces conversations sont maintenant sur les serveurs d'un data broker et potentiellement revendues à des annonceurs.

La morale de l'histoire, c'est que dans le cas des VPN gratuits, le produit c'est littéralement tout ce que vous faites en ligne. Donc si vous voulez vraiment protéger votre vie privée avec un VPN, mieux vaut payer quelques euros par mois pour un service sérieux comme NordVPN ou Surfshark qui n'a pas besoin de revendre vos données pour survivre.

🔒 VPN sérieux vs extensions gratuites douteuses

Pour protéger réellement vos conversations IA et votre vie privée sans finir dans une base de données de data broker, NordVPN fait le job :

- ✓ Politique stricte de non-conservation des logs (auditée par des tiers indépendants)

- ✓ Chiffrement AES-256 de tout votre trafic, y compris vos échanges avec ChatGPT & co

- ✓ Protection contre les fuites DNS et WebRTC

- ✓ Plus de 8000 serveurs dans 110+ pays

- ✓ Garantie satisfait ou remboursé 30 jours

Tester NordVPN sans risque → (lien affilié)

Et désinstallez moi ces merdes immédiatement si vous les avez.

Source

![]()